A inteligência artificial, frequentemente associada à neutralidade matemática, aprende com dados históricos que carregam desigualdades estruturais, reproduzindo e ampliando vieses em decisões automatizadas. No contexto do Dia Internacional da Mulher, em março, o debate destaca que esses vieses não são apenas técnicos, mas envolvem questões jurídicas, regulatórias e institucionais. Sistemas de IA afetam áreas como recrutamento, concessão de crédito, reconhecimento facial e moderação de conteúdo, impactando direitos fundamentais como igualdade, não discriminação, privacidade, acesso ao trabalho e liberdade de expressão.

Onde o Viés Aparece na IA

Estudos internacionais demonstram distorções em sistemas de recrutamento, concessão de crédito, reconhecimento facial e moderação de conteúdo. Mulheres podem ser sub-representadas em recomendações profissionais, mais expostas a assédio em ambientes digitais ou mal identificadas por sistemas biométricos. O viés surge porque os algoritmos aprendem de dados que refletem práticas excludentes do passado, escalando essas distorções sem supervisão humana.

A IA não cria preconceitos, mas os reproduz e amplifica, gerando efeitos desproporcionais sobre grupos historicamente desfavorecidos. Isso ocorre em decisões automatizadas que perpetuam desigualdades estruturais presentes na sociedade.

Exemplo no Mercado de Crédito Imobiliário nos Estados Unidos

Nos Estados Unidos, o debate sobre discriminação no crédito imobiliário ganhou nova dimensão com sistemas automatizados baseados em IA. Pesquisas recentes indicam que, apesar de leis como o Fair Housing Act e instrumentos de fair lending, vieses persistem em modelos de pontuação de crédito e concessão de hipotecas, penalizando grupos desfavorecidos. Esses algoritmos aprendem de dados que carregam marcas de práticas excludentes históricas, como acesso desigual ao crédito e à propriedade.

Historicamente, mulheres enfrentaram barreiras legais e financeiras para acessar crédito imobiliário, com bancos negando hipotecas a mulheres solteiras sem cossignatário masculino. Quando treinados nesses dados, sistemas de IA podem conceder menos hipotecas ou oferecer condições menos favoráveis a mulheres, mesmo com histórico de pagamento sólido. Estudos em algorithmic fairness mostram que ferramentas “cegas” ao gênero ainda reproduzem desigualdades, oferecendo menores oportunidades de financiamento.

Panorama Legislativo no Brasil

No Brasil, o combate à discriminação é um mandamento constitucional, com o artigo 5º consagrando a igualdade formal e material, e o artigo 3º promovendo o bem de todos sem preconceitos de sexo ou outras formas. Decisões automatizadas que produzem efeitos desproporcionais sobre mulheres podem violar esse núcleo estruturante. Dispositivos constitucionais são refletidos no Código de Defesa do Consumidor.

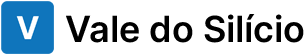

A Lei Geral de Proteção de Dados (LGPD) oferece instrumentos como o princípio da não discriminação (artigo 6º, IX), que veda tratamento de dados para fins discriminatórios ilícitos ou abusivos. O direito à revisão de decisões automatizadas (artigo 20) garante questionamento de decisões automáticas, enquanto princípios de transparência e responsabilização (artigos 6º, IX e X) impõem deveres de governança e conformidade.

O debate legislativo sobre regulação da IA adota abordagem baseada em risco, classificando sistemas para seleção de pessoal, concessão de crédito, saúde, educação ou segurança pública como de alto risco. Esses exigem avaliações prévias de impacto algorítmico, documentação técnica sobre bases de dados, testes de robustez e mitigação de vieses, além de supervisão humana significativa. Sem esse arcabouço, a responsabilização torna-se reativa, em vez de preventiva.

Governança Interna e Compliance Algorítmico

Times diversos identificam riscos que equipes homogêneas não percebem, tornando a inclusão de mulheres em cargos técnicos e decisórios uma medida de mitigação de risco regulatório. Compliance algorítmico exige políticas claras de uso de IA, registro de decisões automatizadas, auditorias periódicas e canais acessíveis de contestação.

Essas práticas visam combater o viés por meio de governança interna, promovendo a detecção e correção de distorções em sistemas de IA.

Agenda para o Futuro Digital

No mês da mulher, reconhece-se que a IA moldará decisões sobre trabalho, crédito, reputação e acesso a oportunidades. Sem parâmetros jurídicos claros e mecanismos de controle, a tecnologia pode consolidar assimetrias históricas sob o manto da eficiência. O desafio envolve preparar o sistema jurídico para exigir correção, transparência e responsabilidade, garantindo que o futuro digital não repita desigualdades do passado em código.